Как дипфейки и ИИ манипулируют выборами

В 2024 году по всему миру проходят около 60 избирательных кампаний. Методы подрыва демократических институтов становятся всё изощрённее при помощи искусственного интеллекта (ИИ) – от дипфейков до поддельных голосовых сообщений. Какие риски несут эти технологии и как законодательство стран реагирует на новые вызовы?

Молдова

В регионе Восточной Европы главным поставщиком дезинформации является Россия. В 2024 году в Молдове пройдут президентские выборы и референдум о членстве в ЕС. В преддверии этих важных событий Россия проводит кампании дезинформации против Молдовы для подрыва доверия к демократическим институтам.

Зимой 2023 года президентка Молдовы Майя Санду оказалась в центре скандала из-за дипфейкового новогоднего видео, где она якобы запретила сбор шиповника, из которого готовят традиционный рождественский напиток. Видео распространяли пророссийские аккаунты, чтобы дискредитировать политику Майи Санду.

Коллаж: Stopfals.md

Кроме того, некоммерческая организация WatchDog.md обнаружила организованную кампанию фейковых комментариев на страницах Facebook. Фейковые посты, созданные пророссийскими аккаунтами, поддерживали бывшего политика Шора и распространяли ложные утверждения о коррупции в прозападном правительстве Майи Санду.

Индия

Издание India Today обнаружило дипфейковое видео индийского развлекательного шоу «Kaun Banega Crorepati» (пер. «Кто хочет стать миллионером?»). Видео стало объектом манипуляций в преддверии выборов в индийский штат Мадхья-Прадеш. Кадры с участием звезды шоу Амитабха Баччана были сфальсифицированы: в них добавлены утверждения о политических событиях, не имеющие отношения к реальности.

Фото: India Today

Ведущий шоу Амитабх Баччан якобы негативно высказывался о программе по сокращению долгов фермеров под управлением Камала Натха, члена правящей партии. На самом деле звезда шоу не произносил эти слова. Исследование India Today показало, что видео были подвергнуты фотошопингу, а голоса участников были изменены. Как утверждает издание, распространением видео занималась оппозиционная партии «Конгресс».

США

В начале 2024 года жительница США Патрисия Гингрич сообщила, что получила необычный звонок. Голос, похожий на голос Джо Байдена, призывал не голосовать на предстоящих президентских праймериз. Позже выяснилось, что этот голос был дипфейком, созданным искусственным интеллектом. Хотя Гингрич поняла, что настоящий президент не может ей звонить, она посчитала, что такие провокации могут повлиять на явку во время выборов. Похожие сообщения получили около 5 000 избирателей Нью-Гэмпшира всего за несколько дней до праймериз в штате. Среди них могли оказаться люди, которые плохо осведомлены о деятельности демократов.

Фото: White House

Однако большую угрозу представляют убедительные дипфейки с детализированными изображениями. Например, перед тем, как отказаться от своей президентской кампании, команда губернатора Флориды Рона ДеСантиса распространила видео со сгенерированными искусственным интеллектом изображениями, на которых Дональд Трамп обнимает иммунолога Энтони Фаучи, несмотря на их публичные конфликты во время пандемии COVID-19. Дипфейк был направлен на создание негативного восприятия Трампа среди его электората, так как многие американцы критически относятся к Фаучи из-за его противоречивой роли в борьбе с пандемией.

Словакия

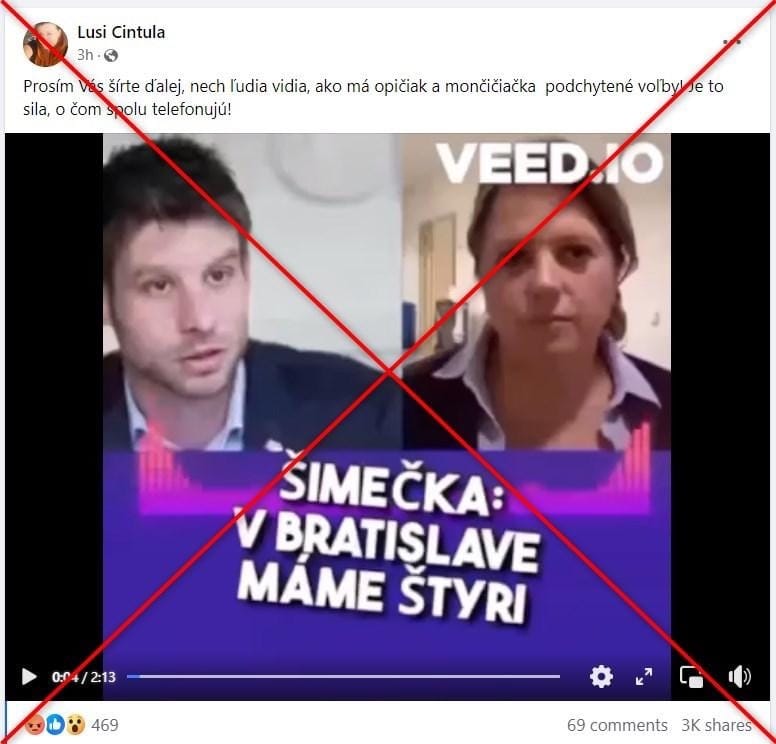

Перед парламентскими выборами в Словакии распространился аудиофайл, якобы записанный лидером партии «Прогрессивная Словакия» Михалом Шимечкой и журналисткой Denník N Моникой Тодовой. На записи председатель партии говорит о покупке голосов цыган, подкупе журналистов и фальсификации выборов.

Хотя аудиозапись не отличается высоким качеством, ею поделились более 3 000 раз на Facebook. Среди тех, кто распространил запись, был и экс-депутат Петер Марчек. Михал Шимечка и Моника Тодова назвали запись фальшивкой. Аналитики и эксперты подтвердили, что аудиофайл является подделкой, созданной с использованием ИИ и синтетического голоса.

Коллаж: Úvodná stránka Fakty

Законодательство и риски

На фоне таких примеров доверие избирателей к информации подрывается, и в результате отвергается даже правдивая информация, чем могут пользоваться политики в своих интересах. Это явление получило название «дивиденд лжеца» – отрицание подлинности компрометирующих записей, утверждая, что они поддельные. Подобная ситуация могла произойти с записью Access Hollywood перед президентскими выборами США в 2016 году. В аудио тогда ещё кандидат в президенты Дональд Трамп непристойно говорит о своих сексуальных контактах с женщинами. Сначала Трамп признал подлинность записи, однако после начал отрицать это. Если бы подобная информация появилась сегодня, то кандидат в президенты вполне возможно мог бы назвать её дипфейком, таким образом снизив репутационный урон.

Кадр из видео 2005 года, на котором Дональд Трамп ведёт разговор с Билли Бушем, ведущим программы Access Hollywood

Законодательства стран реагируют на вызовы искусственного интеллекта по-разному. Так в 2021 году президент США Байден подписал указ о борьбе с дезинформацией, направленный на разработку комплексной стратегии по борьбе с ложной информацией, включая использование ИИ. Хотя дипфейки вызывают опасения на выборах, существенного продвижения этой темы в Конгрессе США нет. Согласно организации Public Citizen, в 20 штатах приняты законы о дипфейках на выборах.

В мае 2023 года Еврокомиссия призвала крупные IT-компании маркировать контент, созданный с использованием ИИ, для повышения прозрачности и обеспечения безопасности информации. В настоящее время Еврокомиссия активно разрабатывает Закон об ИИ (AI Act), который может ввести запрет на использование ИИ в определённых контекстах, например, при создании социальных рейтингов или систем распознавания лиц.

Ещё в 2019 году в России был введен закон о «фейковых новостях», направленный на борьбу с ложной информацией. В реальности российские власти называют фейком любую неудобную им информацию, и используют закон как инструмент цензуры.

В Тайване, например, считают, что свобода слова – это основной ключ к противодействию ложной информации. В 2022 году организация Freedom House провела исследование, согласно которому выяснилось, что страны, защищающие свободу выражения мнений, лучше противостоят распространению ложной информации. Поиск баланса между защитой общественных интересов и свободой слова – это новый вызов для законодательных органов.