Борьба с дезинформацией: cтратегии Meta, Google, X, TikTok и Telegram

Социальные сети стали удобной платформой для распространения дезинформации. Чтобы защитить пользователей и соблюдать законодательство, TikTok, Meta, X (бывший Twitter), Google и Telegram используют разнообразные стратегии борьбы с недостоверной информацией. Media IQ изучил их.

Контент в социальных сетях влияет на миллионы пользователей по всему миру

Глобальные корпорации, включая крупные социальные сети, играют существенную роль в формировании общественного мнения и политических процессов. Исследования показывают, что около 50 % взрослых европейцев и жителей США получают новости через социальные сети: Facebook (26 %), YouTube (22 %), Instagram и TikTok по 15 % и 8 % соответственно. Контент, размещаемый в социальных сетях, имеет потенциал для массированного распространения и влияния на миллионы пользователей по всему миру.

В социальных сетях часто обсуждаются вопросы, связанные с общественным здоровьем, изменением климата, правами человека, а также гендерным и социальным неравенством. Однако нередко возникают силы, которые стремятся манипулировать общественным мнением или вводить пользователей в заблуждение.

Коллаж: BeLeave

Например, компания BeLeave во время референдума о Брексите через рекламные изображения манипулятивно призывала целевую аудиторию голосовать за выход Великобритании из ЕС. С другой стороны антипрививочные движения и сторонники теории заговора распространяли в Twitter ложные утверждения о том, что Билл Гейтс использует разработки вакцин для микрочипирования населения.

С началом полномасштабного вторжения в Украину активизировалась российская дезинформация. Ложные заявления о том, что украинское правительство контролируется нацистами и занимается геноцидом русского населения в Донецкой и Луганской областях, до сих пор распространяются в телеграм-каналах.

В ответ на распространение дезинформации многие страны постепенно ужесточают законодательство в сфере модерации контента, а корпорации обновляют свои гайдлайны, следя за качеством информации. Корпорации несут ответственность не только перед своими пользователями, но и перед обществом в целом.

Meta: сотрудничество и искусственный интеллект

Meta владеет такими популярными продуктами, как Facebook, Instagram, Threads, и использует целый арсенал инструментов для борьбы с дезинформацией. Основная стратегия компании включает три направления: удаление, сокращение и информирование.

Удаление дезинформации происходит в случаях, когда ложная информация может привести к немедленному физическому вреду. Например, во время пандемии Сovid-19 удалялись ложные утверждения о том, что заболеть безопаснее, чем получить вакцину, или о том, что вакцины токсичны, опасны, вызывают аутизм. Также удалялась информация, что вакцины содержат микрочипы. Кроме этого, удаляется дезинформация, которая может повлиять на голосование на выборах: скоординированные действия сети аккаунтов, страниц и групп, которые пытаются манипулировать общественными обсуждениями.

Ещё одно основание для удаления манипулятивного контента, созданного с помощью искусственного интеллекта (ИИ), или дипфейк. Обычному человеку не заметны изменения, и ему внушается, что субъект видео сказал слова, которых он не говорил. Примером является видео с Бараком Обамой, созданное Джорданом Пилом и опубликованное BuzzFeed. В этом видео Обама якобы произносит оскорбления в адрес Дональда Трампа, но на самом деле его голос был сгенерирован и синхронизирован с движениями губ Обамы с помощью ИИ.

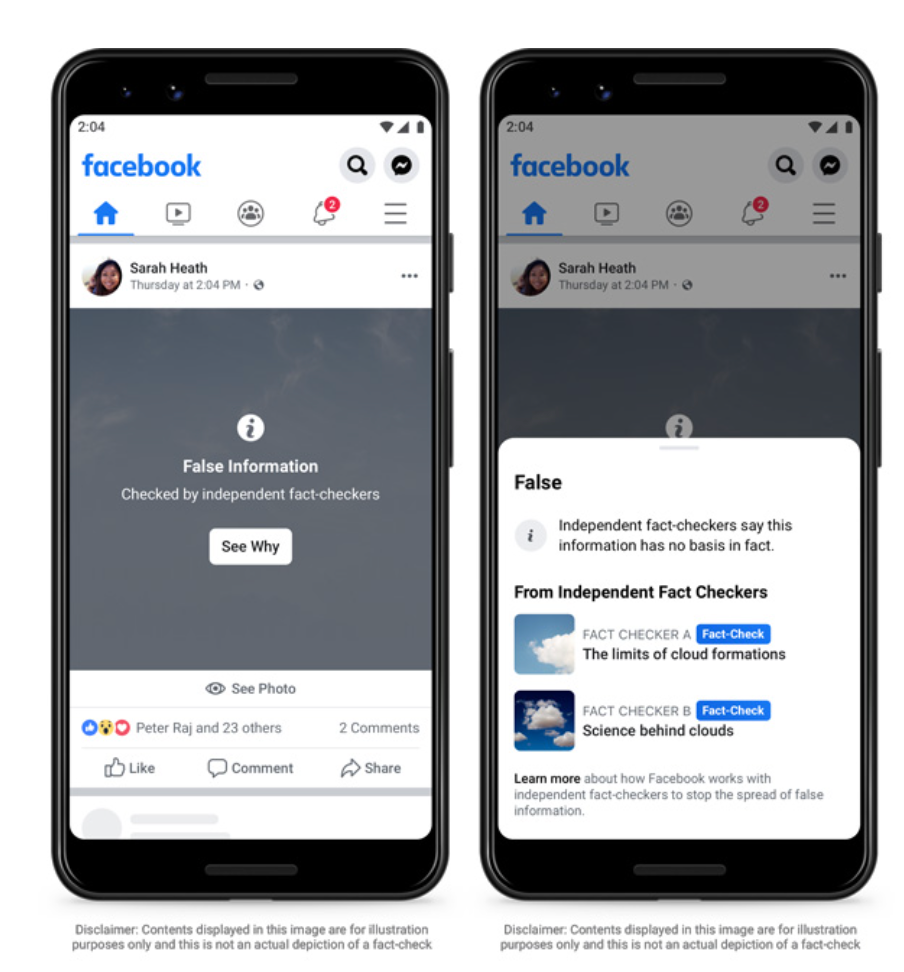

В 2016 году Facebook запустил Программу проверки фактов. В 2019 году программа расширилась на Instagram, и в 2024 – на Threads. Она сосредоточена на выявлении и устранении вирусной дезинформации, особенно фейков, не имеющих очевидной фактической основы. Проверкой фактов занимаются партнёры Meta. Корпорация работает почти со 100 сторонними организациями по проверке фактов на более чем 60 языках по всему миру. Эти фактчекеры сертифицированы через независимую Международную сеть проверки фактов (IFCN) или через Европейскую сеть стандартов проверки фактов (EFCSN).

Иллюстрация: профиль IFCN на Facebook

Партнёр может оценить контент как ложный, то есть не имеющий фактологического основания и вводящий пользователей в заблуждение. К такому контенту относятся ложные цитаты, невозможные утверждения, теории заговора, безосновательные обвинения, контент из фальшивых новостных источников и манипулирование контекстом. Распространение такого контента в ленте новостей и других местах сокращается, чтобы его увидело меньше людей. Страницы Facebook, группы, профили, веб-сайты и аккаунты Instagram, многократно делящиеся таким контентом, исключаются из рекомендаций.

Например, в июне 2024 года в социальных сетях распространилось видео, утверждающее, что российские военные корабли стреляли боевыми ракетами у побережья Флориды на пути к Кубе. Утверждение оказалось ложным, так как использовалось видео 2018 года с испытаниями ракет в Белом море. Департамент обороны США и фактчекеры из FactCheck.org опровергли это заявление, назвав его недостоверным. Программа не вмешивается в индивидуальное выражение мнений, дебаты, явно сатирический или юмористический контент или бизнес-споры.

Meta также добавляет уведомления с надписью Fact-Check к проверенным постам. Это позволяет пользователям увидеть заключения фактчекеров и самим решить, что читать, чему доверять и чем делиться.

Иллюстрация на офицальной странице Facebook

Meta также сотрудничает с организациями по всему миру: Poynter, Africa Check, Full Fact, Chequeado для продвижения новостной грамотности. Пользователям объясняют, как самостоятельно распознавать дезинформацию и проверять факты через видеоролики, статьи, инфографики и интерактивные курсы. Для проекта FactCheckEU Facebook расширил свою программу проверки фактов, добавив новые партнёрские организации. Теперь Facebook сотрудничает с 52 сайтами по проверке фактов в 33 странах, что в четыре раза больше по сравнению с апрелем прошлого года.

Google: партнёрство и исследования

Корпорация Google владеет такими продуктами как Google Search, YouTube, GoogleAds, где также борется с дезинформацией, применяя разнообразные стратегии на своих сервисах.

У компании есть команды экспертов по всему миру, которые следят за качеством и достоверностью информации. В начале 2021 года Google запустила Центр инженерии безопасности для ответственного контента в Дублине. Здесь компания занимается разработками, проводит исследования и улучшает свои стандарты.

Дезинформация проявляется по-разному на разных платформах Google – от поиска до YouTube и Google Ads. Борьба с ней начинается с установления правил, запрещающих определенные виды вредоносного контента и поведения. Компания использует сложные алгоритмы ранжирования, чтобы снижать видимость сайтов с недостоверной информацией в результатах поиска. Это позволяет уменьшить доступность спорных источников для пользователей.

Когда обнаруживается контент, нарушающий правила Google, компания принимает меры – блокирует, удаляет или ограничивает распространение вредоносного контента. Например, в 2020 году Google на платформе YouTube изменил свои системы рекомендаций, чтобы значительно уменьшить в рекомендациях количество контента, рассказывающего, что Земля плоская. Вместо этого зрителям стали предлагаться видео с научно обоснованной информацией и объяснениями.

Однако объём контента слишком велик, чтобы Google самостоятельно модерировал контент, поэтому компания сотрудничает с партнёрами в каждой стране, где работает.

Например, Google и YouTube выделили грант в размере 13,2 миллиона долларов Международной сети проверки фактов при институте Пойнтера для поддержки сети из 135 организаций по проверке фактов в 65 странах, охватывающих более 80 языков.

В Великобритании Google поддерживает инициативы Full Fact, независимой благотворительной организации, занимающейся проверкой фактов. В Испании Google сотрудничает с Maldita.es, организацией, занимающейся развенчанием дезинформации и повышением медийной грамотности. В Германии национальное новостное агентство DPA работает с Google над предоставлением услуг и инструментов для проверки фактов, особенно в период выборов.

Компания также подписала Кодекс ЕС по борьбе с дезинформацией в 2018 и 2022 году. Первый Кодекс включал 21 обязательство, направленное на улучшение прозрачности и подотчётности онлайн-платформ, в том числе улучшение проверки размещения рекламы и обеспечение прозрачности политической рекламы. В 2022 году Кодекс был обновлён, и сейчас включает 44 обязательства и 127 мер, таких как предоставление данных по каждой стране и улучшение доступа к данным для исследователей.

В более специфичных вопросах, например, здоровья, Google работает со Всемирной организацией здоровья (ВОЗ) и американским Центром по контролю и профилактике заболеваний (Centers for Disease Control and Prevention). Кроме того, в 2021 году Google внёс 25 миллионов евро на запуск Европейского фонда медиа и информации, чтобы помочь учёным, издателям и некоммерческим организациям запускать свои собственные программы по медиаграмотности, таким образом инвестируя в образование своих пользователей.

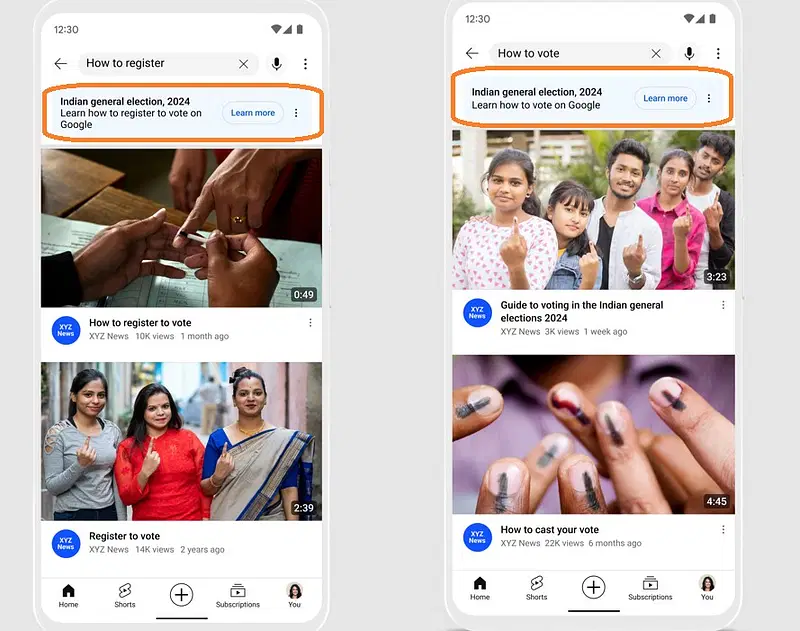

Также Google внедрил на платформе YouTube информационные панели к видео на спорные темы, такие как Covid-19 и выборы.

Скриншоты: YouTube India

Крупные медиа имеют плашку с указанием источника финансирования. Каналы, финансируемые государственными организациями, такими как Russia Today или Voice of America, помечаются ярлыками «финансируемые государством» с указанием страны, которая предоставляет финансирование. Это также касается публичных вещательных служб, таких как BBC или PBS. Видео, нарушающие правила сообщества, удаляются, что способствует снижению распространения ложной информации. Модерация контента происходит с помощью искусственного интеллекта и службы поддержки.

Google борется с дезинформацией, применяя гибкий подход в зависимости от продукта, сохраняя основной акцент на сотрудничестве с другими организациями и повышении медиаграмотности пользователей.

X: сотрудничество и комьюнити

X, ранее известный как Twitter, до прихода Илона Маска активно боролся с дезинформацией. Платформа внедрила систему предупреждений о дезинформации, показывая пользователям предупреждения и ссылки на проверенные источники при попытке ретвитнуть ложную или вводящую в заблуждение информацию.

Также активно удалялся контент, нарушающий правила, особенно касающийся выборов, Covid-19 и вакцинации. Твиты, содержащие спорную информацию, часто помечались специальными метками с ссылками на проверенные данные.

Twitter сотрудничал с независимыми организациями по проверке фактов, чтобы выявлять и удалять ложные сообщения, а аккаунты, систематически распространявшие дезинформацию, могли быть временно заблокированы или полностью удалены.

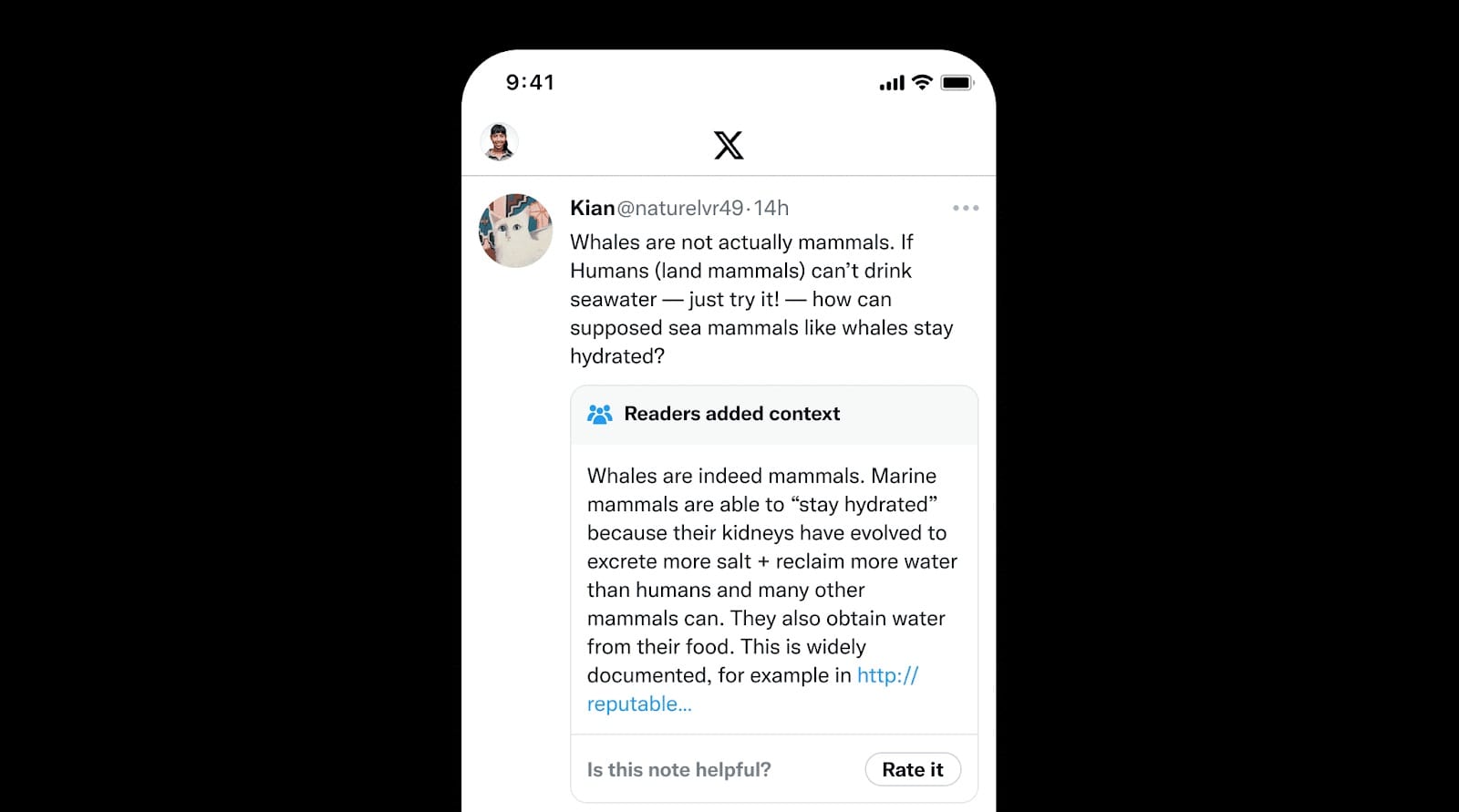

В 2021 году Twitter объявил о начале сотрудничества с Reuters и The Associated Press. Twitter сотрудничал с этими организациями для проверок фактов в «Моментах», «Трендах» и других разделах платформы. Тогда же компания обратилась за консультацией для улучшения своего пилотного проекта под названием Birdwatch, в рамках которого обычные пользователи (так называемые «птицеловы») подавали заметки, исправляющие потенциально ложную информацию в твитах. В этих заметках содержались ссылки на проверенные источники, которые пользователи Twitter могут использовать для оценки достоверности информации.

С приходом Илона Маска на пост главы Twitter в конце 2022 года произошли значительные изменения. Маск заявил о намерении сделать платформу более свободной для выражения мнений, что привело к ослаблению модерации контента и вызвало беспокойство ростом дезинформации. Community Notes (заметки), ранее известная как Birdwatch, представляет собой программу X, позволяющую некоторым пользователям добавлять контекст к твитам, которые могут вводить в заблуждение или содержать неполную информацию. Программа запущена в более чем 15 странах и насчитывает около 133 000 пользователей.

Пример Community Notes c официального сайта Х

Однако на практике эксперимент оказался неудачным. Пользователи X написали около 122 000 заметок, но только 8,5 % были видны публике. Чтобы заметки стали публичными, их должны были оценить другие пользователи Community Notes, которые проверяют качество источников, ясность и важность контекста. Если заметки получают достаточное количество положительных оценок, они становятся публичными.

Программа сталкивается с серьёзными проблемами из-за требования консенсуса среди людей с различными политическими взглядами, которым крайне трудно согласиться по многим вопросам. В результате многие важные Community Notes остаются невидимыми для публики. С другой стороны, исследования Джона Айерса из Университета Калифорнии показывают, что заметки были эффективны в борьбе с мисинформацией на тему вакцин против Covid-19.

Бывший глава службы доверия и безопасности Twitter Йоэль Рот отметил слабости Community Notes, заявив, что компания сделала ставку лишь на заметки, в ущерб другим методам борьбы с дезинформацией.

TikTok: инновации и консультации

TikTok обладает строгими правилами относительно определённых видов дезинформации: медицинской, климатической, выборной, вводящей в заблуждение, созданной с помощью ИИ, теории заговора, вопросы общественной безопасности. В зависимости от степени вреда TikTok удаляет контент или уменьшает его охват.

Политики TikTok по дезинформации применяются к контенту независимо от намерений автора. Поэтому они охватывают как дезинформацию (преднамеренно вводящий в заблуждение контент), так и мисинформацию, которая могла быть распространена без намерения обмана. TikTok также борется с дезинформацией, удаляя аккаунты, которые регулярно публикуют нарушающий правила контент, и имеет экспертные команды, постоянно мониторящие кампании дезинформации, нехарактерное для аккаунта поведение и операции по влиянию.

TikTok обнаруживает дезинформацию с помощью автоматизированных технологий, пользовательских отчётов и проактивных брифингов от экспертов и партнёров по проверке фактов. Когда происходят события с высоким уровнем риска, такие как выборы или чрезвычайные ситуации, платформа запускает дополнительные усилия по обнаружению на местном уровне, часто сотрудничая с экспертами или властями.

Иногда верифицировать информацию сложно, в таких случаях TikTok может пометить контент как «неподтверждённый» и уменьшить его распространение, делая его недоступным для ленты «Для вас».

Некоторую дезинформацию можно обработать с помощью технологий, но из-за скорости её распространения ИИ не может верифицировать все факты самостоятельно. Поэтому TikTok тесно сотрудничает с 18 аккредитованными IFCN организациями по проверке фактов, которые оценивают точность контента в TikTok на более чем 50 языках и в 100 странах по всему миру. Партнёры не модерируют контент напрямую, но оценивают, является ли утверждение истинным, ложным или неподтверждённым, чтобы модераторы могли принять правильные решения на основе принципов сообщества. Партнёры также делятся информацией, которая помогает выявлять вредную дезинформацию и предугадывать её тренды.

Онлайн-дезинформация является глобальной проблемой, но в разных странах существует своя специфика. TikTok сотрудничает с создателями контента и местными экспертами, такими как общественные организации, органы здравоохранения, избирательные комиссии и местные эксперты по проверке фактов.

Помимо действий в отношении самого контента, TikTok активно работает над предотвращением дезинформации, предоставляя сообществу ресурсы по медиаграмотности. В 2022 году компания запустила TikTok Digital Literacy hub, целью которого является развитие критического мышления у пользователей.

TikTok реагирует на развитие ИИ, который может потенциально запутывать или вводить в заблуждение зрителей. С мая 2024 TikTok начал маркировать контент, созданный при помощью искусственного интеллекта.

Telegram: независимость и потенциальное партнёрство

А что же Telegram? Павел Дуров, создатель мессенджера, предпочитает мягкий подход к модерации контента. Большинство социальных сетей занимают более жёсткую позицию, поэтому Telegram стал платформой, где публикуется информация, заблокировать которую просто так нельзя. Не случайно Telegram пользуется популярностью как у демократических движений Беларуси и Ирана, так и ультраправых групп в США.

Тем не менее, Telegram осуществляет модерацию контента, в том числе для соблюдения местных законов, которые компания считает легитимными. Например, Telegram заблокировал чат-бот «Умного голосования» Алексея Навального, так как он нарушил принцип «дня тишины» во время парламентских выборов в России в 2021 году. По приказу Верховного суда Бразилии Telegram заблокировал канал распространителя дезинформации Аллана дос Сантоса. Кроме того, телеграм-канал может быть заблокирован, если там спространяется откровенный (сексуальный) контент, нарушаются авторские права, распространяется насилие и разжигается ненависть.

На официальной странице указано, что наиболее эффективный способ борьбы с дезинформацией, с точки зрения Telegram, – предоставить читателям инструменты для тщательного анализа средств массовой информации, которые они потребляют.

Во время эпидемии Covid-19 Павел Дуров в своём канале заявил, что Telegram не удалял новости, связанные с утечкой вируса из лаборатории, потому что «мы не думали, что это наша роль – решать, во что верить нашим пользователям». Telegram совместно с правительствами 19 стран запустил анти-ковидную инициативу, где публиковалась официальная информация на эту тему.

Во время полномасштабного вторжения России в Украину Дуров принял решение не удалять телеграм-каналы на военную тему, так как «для многих это единственный источник информации», призывая пользователей критически относиться к любой информации. Таким образом Telegram скорее перекладывает ответственность за потребление недобросовестного контента на пользователей.

Согласно изданию Bloomberg, европейские чиновники считают мессенджер главным оружием российской пропаганды в распространении дезинформации, направленной на подрыв поддержки Украины. Однако Telegram не подпадает под европейские законы регулирования. Со слов представителей платформы, аудитория Telegram в ЕС менее 45 млн человек, поэтому мессенджер не попадает под действие закона о цифровых услугах.

Недавно телеграм-канал «Код Дурова» заявил, что в исходном коде бета-версии Telegram появилась новая функция Fact Check. Как утверждают авторы канала, функция предназначена для проверки фактов. Важно отметить, что это неофициальное заявление. «Код Дурова» формально не связан с Павлом Дуровым. Телеграм-канал сообщает, что в рамках Fact Check платформа будет сотрудничать с государственными агентствами, занимающимися проверкой информации, что уже возмутило фактчекерское сообщество.

Похоже, рост популярности вынуждает Telegram постепенно подчиняться европейскому законодательству. Представителям Telegram всё труднее утверждать, что аудитория мессенджера в ЕС меньше 45 млн человек. Скорее всего, запуск функции Fact Check станет ответной реакцией на требование европейского законодательства.